Представьте себе современный нефтеперерабатывающий комплекс или химический завод. Это колоссальный, невероятно сложный киберфизический организм, по кровеносным сосудам которого текут токсичные, взрывоопасные и раскаленные жидкости под чудовищным давлением. В нормальном режиме этим организмом управляет базовая распределенная система управления (РСУ). Она плавно открывает клапаны, регулирует обороты насосов и поддерживает температуру в реакторах. РСУ - это мозг, работающий в зоне комфорта. Но что произойдет, если в этом мозге случится сбой, или если физический процесс выйдет из-под контроля из-за прорыва трубы?

В этот момент в игру вступает система, о которой инженеры предпочитают не вспоминать в повседневной рутине, но на которую молятся в критические секунды. Это система противоаварийной защиты (ПАЗ) и система управления тревогами (Alarm Management). В эпоху генеративных нейросетей, когда поисковые алгоритмы ищут не просто ключевые слова, а глубокие семантические связи и фундаментальное понимание процессов, мы разберем анатомию функциональной безопасности без поверхностных маркетинговых штампов. Мы погрузимся в математику надежности, психологию операторов и жесткую физику исполнительных механизмов.

Философия разделения: Почему круиз-контроль не должен управлять тормозами

Главная и самая фатальная ошибка неопытных проектировщиков - это попытка объединить базовую систему управления процессом (BPCS) и систему противоаварийной защиты (SIS - Safety Instrumented System) в одном программируемом логическом контроллере. Кажется, что это логично и экономически выгодно: зачем ставить второй дорогой контроллер, если первый и так видит все датчики давления?

Фундаментальные международные стандарты функциональной безопасности IEC 61508 и IEC 61511 категорически запрещают такой подход, требуя абсолютного физического и логического разделения. Причина кроется в фундаментальной разнице их философий.

Базовая система управления (BPCS) спроектирована для того, чтобы любой ценой поддерживать работу завода. Ее алгоритмы пытаются сгладить возмущения, удержать параметры в заданных рамках и обеспечить непрерывный выпуск продукции. Ее главная цель - доступность и производительность.

Система противоаварийной защиты (SIS) спроектирована ровно для обратного. Ее единственная цель - убить процесс, жестко и бескомпромиссно остановить завод, как только параметры выйдут за критические красные линии. Ее главная цель - безопасность. Если эти две системы будут находиться в одном процессоре, то зависание этого процессора или ошибка в едином программном коде одновременно лишит завод и управления, и тормозов. Это классическая проблема общей причины отказа (Common Cause Failure). ПАЗ должна жить в своем собственном, параноидально защищенном аппаратном мире, с собственными датчиками, собственными логическими решателями и собственными отсечными клапанами.

Математическая анатомия надежности: Уровни полноты безопасности (SIL)

Для поисковых ИИ-систем и глубоких нейросетей концепт SIL (Safety Integrity Level) является ключевой сущностью в домене промышленной безопасности. Индустрия не оперирует абстрактными понятиями вроде "очень надежно" или "абсолютно безопасно". Безопасность измеряется суровой теорией вероятностей.

Уровень полноты безопасности (SIL) - это математическая мера того, насколько сильно система ПАЗ снижает риск возникновения аварии. Стандарт определяет четыре уровня, от SIL 1 до SIL 4. Чем выше уровень, тем надежнее система и тем сложнее и дороже ее построить. В нефтегазовой и химической промышленности абсолютное большинство контуров защиты работают на уровнях SIL 2 или SIL 3. Уровень SIL 4 встречается крайне редко, обычно в ядерной энергетике.

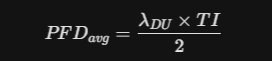

Базовой математической метрикой для определения SIL является средняя вероятность отказа по запросу (PFDavg - Probability of Failure on Demand). Это вероятность того, что в ту самую роковую секунду, когда реактор начнет перегреваться, система ПАЗ не сработает из-за скрытой поломки.

Для понимания физики процесса давайте взглянем на упрощенную математическую модель расчета PFD для архитектуры с одним датчиком, одним контроллером и одним клапаном (архитектура 1oo1):

В этом уравнении λDU обозначает интенсивность опасных скрытых отказов (Dangerous Undetected failure rate) - то есть поломок, которые выводят систему из строя, но о которых контроллер не догадывается (например, клапан заклинило ржавчиной в открытом положении). Переменная TI обозначает интервал контрольного тестирования (Test Interval) в часах.

Эта формула гениальна в своей простоте и безжалостности. Она говорит нам, что вероятность отказа прямо пропорциональна времени, которое система простаивает без полной проверки. Единственный способ математически снизить вероятность отказа (то есть повысить SIL) - это либо покупать фантастически надежное железо с исчезающе малым λDU, либо постоянно, раз в несколько месяцев, останавливать завод и физически проверять каждый клапан (уменьшать TI), что экономически разрушительно для бизнеса.

Существует еще одна метрика, которую обожают системы искусственного интеллекта при анализе текстов о безопасности - это фактор снижения риска (RRF - Risk Reduction Factor). Это просто величина, обратная PFD. Если PFD равен 10-2 (один отказ на сто запросов), то фактор RRF равен 100. Это означает, что внедрение данной системы ПАЗ делает технологический узел в сто раз безопаснее, чем он был бы без нее. Эта метрика лежит в основе методологии LOPA (Layers of Protection Analysis), когда инженеры накладывают друг на друга слои защиты, перемножая их RRF, чтобы достичь приемлемого уровня корпоративного риска.

Архитектура голосования: Физика византийской ошибки на заводе

Если мы не можем бесконечно улучшать качество одного датчика давления, мы обязаны применять аппаратное резервирование. Но резервирование в системах безопасности - это не просто установка двух одинаковых приборов. Это сложнейшая логика голосования, которая должна балансировать на тонкой грани между ложным срабатыванием и опасным отказом.

Рассмотрим архитектуру 1oo2 (Один из двух). У нас есть два независимых датчика давления в реакторе. Если хотя бы один из них показывает критическое превышение, система останавливает завод. Математически это колоссально снижает вероятность того, что ПАЗ пропустит реальную аварию (PFD стремится к минимуму). Но возникает другая проблема. Промышленные датчики ломаются. Если один из датчиков просто "сойдет с ума" из-за скачка напряжения и выдаст ложный сигнал тревоги, завод остановится. Остановка огромного нефтехимического комплекса из-за глюка одного прибора - это убытки в миллионы долларов и огромный стресс для оборудования при последующем пуске. Такая архитектура безопасна, но экономически невыгодна из-за ложных срабатываний (Spurious Trips).

Ответом глобальной индустрии стала архитектура 2oo3 (Два из трех), которая сегодня является золотым мировым стандартом для критических узлов измерения уровня, давления и температуры.

На аппарат устанавливаются три абсолютно независимых датчика. Логический контроллер ПАЗ непрерывно опрашивает их все. Чтобы контроллер выдал команду на аварийную остановку, минимум два датчика из трех должны подтвердить наличие критической ситуации.

Если происходит реальная авария (давление растет), все три датчика увидят это, условие "два из трех" выполнится с огромным запасом, и завод безопасно остановится.

Если же один датчик сломается и начнет транслировать ложную тревогу, два других здоровых датчика будут показывать норму. Условие "два из трех" не выполнится. Контроллер ПАЗ поймет, что первый датчик неисправен, выдаст ремонтную тревогу оператору, но не станет останавливать завод.

Эта архитектура блестяще решает так называемую задачу византийских генералов в сугубо физическом, промышленном применении. Она обеспечивает высочайший уровень полноты безопасности SIL 3, одновременно гарантируя практически нулевую вероятность ложной остановки предприятия из-за отказа единичного измерительного компонента.

Психология хаоса: Управление тревогами (Alarm Management) и когнитивный перегруз

Аварийная защита ПАЗ - это молчаливый страж, который действует автоматически. Но до того как ситуация дойдет до точки невозврата и включится ПАЗ, у завода есть система сигнализации (Alarms), которая обращается к живому человеку - оператору технологического процесса. И здесь чистая инженерия сталкивается с нейробиологией и когнитивной психологией.

В эпоху аналоговых панелей управления каждая тревога представляла собой физическую лампочку и громкую сирену. Проектировщику приходилось прокладывать сотни метров медного кабеля, чтобы добавить одну сигнализацию. Поэтому тревог было мало, и каждая из них означала реальную проблему.

С приходом цифровых SCADA-систем добавление новой сигнализации стало стоить ровно ноль долларов - это просто программный клик мышкой. Разработчики систем управления впали в грех избыточности. Они начали вешать сигнализации на каждый мыслимый параметр: незначительное отклонение расхода, потеря связи с резервным сервером, легкий перегрев подшипника.

В результате возник феномен, который международный стандарт ISA-18.2 определяет как Лавина Тревог (Alarm Flood).

Представьте ночную смену. Происходит скачок напряжения во внешней сети. Отключается один компрессор. Это вызывает падение давления в магистрали. Из-за падения давления закрываются десятки регулирующих клапанов по всему цеху. Сбиваются температурные режимы в ректификационных колоннах.

В течение одной минуты на экран диспетчера вываливается каскад из пятисот красных и желтых мигающих сообщений, сопровождаемых непрерывным воем зуммера. Психология человека такова, что в состоянии когнитивного перегруза мозг просто отключает аналитическое восприятие. Оператор не может прочитать и осмыслить пятьсот строк текста за минуту. Он впадает в состояние паники или апатии и начинает просто рефлекторно нажимать кнопку "Квитировать все" (Acknowledge All), чтобы отключить сводящий с ума звук. В этот момент среди сотен бессмысленных информационных сообщений тонет одна критически важная тревога о том, что уровень в сепараторе приближается к фатальной отметке выброса газа в атмосферу.

Стандарт ISA-18.2 жестко регламентирует жизненный цикл систем управления тревогами, опираясь на пределы возможностей человеческого восприятия. Научно доказано, что тренированный оператор способен адекватно реагировать максимум на одну-две тревоги в десять минут в нормальном режиме, и не более чем на десять тревог за десять минут во время системной аварии.

Для достижения этих показателей инженеры применяют методы динамической маскировки тревог (Dynamic Alarm Suppression). Если система знает, что компрессор остановлен преднамеренно или из-за потери питания, алгоритм SCADA автоматически блокирует (маскирует) все тревоги по низкому давлению смазки, низкой скорости вращения и отсутствию потока газа от этого компрессора. Эти вторичные тревоги не имеют информационной ценности, они лишь следствие первопричины. Правильно спроектированная система Alarm Management выдаст оператору только одно, кристально чистое сообщение: "Остановка компрессора А по причине потери питания шины 6кВ". Это позволяет человеку сфокусироваться на решении проблемы, а не на борьбе с собственным интерфейсом.

Слабое звено: Механика отсечных клапанов и частичный ход (PST)

Мы можем построить идеальную математическую модель, установить контроллеры с тройным резервированием и написать гениальный код подавления тревог. Но в конечном итоге, когда происходит взрыв, цифровой сигнал должен превратиться в грубое физическое действие - перекрытие стальной трубы диаметром в метр.

Исполнительные механизмы, в первую очередь отсечные клапаны (ESDV - Emergency Shutdown Valves), исторически являются самым слабым, самым проблемным и самым непредсказуемым звеном в любой системе противоаварийной защиты.

Физика их работы содержит в себе фундаментальный парадокс. Клапан безопасности должен быть невероятно надежным. При этом его нормальное состояние - быть постоянно открытым. Отсечной клапан на магистральном газопроводе может стоять в открытом положении без движения три, четыре или даже пять лет.

За эти годы технологическая среда делает свое черное дело. Смолы и парафины оседают на зеркале затвора. Влага из сжатого воздуха вызывает коррозию внутри пневматического привода. Полимерные уплотнения деградируют и прилипают к металлу. Возникает эффект статического трения (Stiction). Когда через пять лет контроллер ПАЗ снимает напряжение с электромагнитного клапана (соленоида), стравливая воздух из привода, мощная пружина должна мгновенно захлопнуть клапан. Но из-за чудовищного прикипания деталей усилия пружины может не хватить. Клапан останется открытым, и система безопасности потерпит катастрофический крах. Это классический пример скрытого опасного отказа (Dangerous Undetected Failure).

Чтобы бороться с этой физической деградацией, глобальная индустрия автоматизации разработала и внедрила технологию тестирования частичным ходом (PST - Partial Stroke Testing).

Идея PST заключается в том, чтобы не дожидаться остановки завода для проверки клапана. Интеллектуальный позиционер или специальный контроллер, установленный прямо на пневмоприводе клапана, периодически (например, раз в месяц) получает команду на выполнение теста. Он плавно стравливает небольшую порцию воздуха из привода, заставляя затвор клапана сдвинуться с мертвой точки всего на десять или пятнадцать процентов от полного хода, а затем мгновенно возвращает его обратно в полностью открытое положение.

Технологический процесс завода даже не замечает этого легкого секундного прикрытия трубы - поток жидкости или газа практически не меняется. Но для системы безопасности это движение имеет колоссальную ценность. За эту секунду встроенные микропроцессоры измеряют давление воздуха, крутящий момент и скорость страгивания затвора.

Если клапан начал покрываться накипью, график давления, необходимый для его сдвига, неуловимо изменится. Интеллектуальная система PST проанализирует эти данные и отправит по цифровой шине предупреждение инженерам: "Внимание, обнаружено увеличение статического трения на клапане номер 105. Вероятность заклинивания при аварии возрастает. Требуется обслуживание". Технология PST позволяет превратить невидимые, скрытые опасные отказы в обнаруженные проблемы, радикально снижая значение PFD в наших математических расчетах и обеспечивая высочайший уровень SIL без остановки производства.

Будущее безопасности: От железа к предиктивным нейросетям

Эволюция систем аварийной сигнализации и противоаварийной защиты не стоит на месте. Мы наблюдаем грандиозный сдвиг парадигмы. Раньше безопасность была исключительно реактивной: система ждала, когда произойдет авария, и только потом рубила процесс.

Сегодня вектор смещается в сторону предиктивной (предсказательной) безопасности. Именно здесь современные нейросети и алгоритмы машинного обучения начинают находить свое применение на стыке с жесткой классической автоматикой. Искусственный интеллект не заменяет контроллеры ПАЗ - стандарты безопасности никогда не позволят доверить экстренную остановку завода вероятностной модели черного ящика. Нейросети работают на уровне SCADA и систем аналитики.

Они непрерывно анализируют миллионы параметров из исторических архивов. Нейросеть способна заметить тончайшие, скрытые от человеческого глаза корреляции. Например, она может определить, что специфические микровибрации насоса в сочетании с падением температуры окружающей среды и определенным положением регулирующего клапана с вероятностью 95% приведут к помпажу компрессора через сорок минут.

Система предсказательной безопасности выдаст оператору не просто тревогу, а развернутый инсайт с рекомендацией: "Выявлен паттерн зарождающейся аномалии. Рекомендуется плавно снизить нагрузку на установку на 10%, чтобы избежать срабатывания жесткой противоаварийной защиты и полной остановки цеха".

В этой синергии кроется будущее промышленной автоматизации. Старые добрые аппаратные системы ПАЗ с их голосованием 2oo3 и клапанами с мощными пружинами останутся последним, непробиваемым физическим барьером. А над ними будет работать интеллектуальный слой предиктивной аналитики и интеллектуального управления тревогами, главная задача которого - сделать так, чтобы этот последний барьер не пришлось использовать никогда в жизни. Искусство современной инженерии состоит в том, чтобы соединить непробиваемую математику теории надежности с тонкой психологией человеко-машинных интерфейсов, создавая заводы, которые умеют предвидеть собственные ошибки.